EnergeticAI: TensorFlow.js Optimizado para Servicios Servless con Inicio Rápido en Frío

En el dinámico mundo de la inteligencia artificial y el desarrollo web, la optimización de modelos de aprendizaje automático para entornos serverless ha cobrado especial relevancia. EnergeticAI es una solución innovadora que combina TensorFlow.js con una arquitectura serverless, diseñada para reducir significativamente el tiempo de inicio en frío. Esta tecnología no solo mejora la eficiencia y la velocidad de respuesta, sino que también optimiza el uso de recursos, lo que resulta en una experiencia de usuario más fluida y en costos operativos más bajos. A continuación, exploraremos cómo EnergeticAI logra estos avances y sus aplicaciones prácticas en el desarrollo moderno.

- EnergeticAI: TensorFlow.js optimizado para funciones sin servidor

- Características clave de EnergeticAI

- Inicio rápido en frío: La solución para la latencia de las funciones sin servidor

- Optimización de recursos: Mejor rendimiento con menos consumo

- Modelos pre-entrenados: Acelerando el desarrollo de aplicaciones de IA

- Compatibilidad amplia: Manteniendo la familiaridad con TensorFlow.js

- ¿Qué es TensorFlow y para qué sirve?

- ¿Qué función de TensorFlow se usa para definir y entrenar modelos?

- ¿Qué hace realmente tensorflow?

- ¿Qué necesito para usar TensorFlow?

- Preguntas Frecuentes de Nuestra Comunidad (FAQ)

EnergeticAI: TensorFlow.js optimizado para funciones sin servidor

EnergeticAI es una versión optimizada de TensorFlow.js que está specifically diseñada para mejorar la performance en funciones sin servidor. Este framework se destaca por su inicio rápido en frío, lo que reduce significativamente el tiempo de espera para la ejecución de funciones, y también ofrece una colección de modelos pre-entrenados que facilitan el desarrollo y despliegue de aplicaciones de inteligencia artificial.

Características clave de EnergeticAI

EnergeticAI presenta varias características clave que lo hacen ideal para entornos serverless:

- Inicio rápido en frío: Reduce el tiempo de inicialización de funciones, mejorando la latencia.

- Optimización de recursos: Minimiza el consumo de CPU y memoria.

- Modelos pre-entrenados: Proporciona acceso a una biblioteca de modelos entrenados para acelerar el desarrollo.

- Compatibilidad amplia: Mantiene la compatibilidad con TensorFlow.js, facilitando la migración.

- Integración sencilla: Ofrece APIs fáciles de usar para la integración con otras herramientas y servicios.

Inicio rápido en frío: La solución para la latencia de las funciones sin servidor

El inicio en frío es un desafío común en los entornos serverless, donde las funciones pueden tardar varios segundos en inicializarse. EnergeticAI aborda este problema optimizando el proceso de arranque y reduciendo el tiempo de carga de bibliotecas y modelos. Como resultado, las aplicaciones pueden ser más responsivas y ofrecer una mejor experiencia de usuario.

Optimización de recursos: Mejor rendimiento con menos consumo

En los entornos sin servidor, la eficiencia en el uso de recursos es crucial. EnergeticAI optimiza el consumo de CPU y memoria para que las funciones puedan ejecutarse de manera más eficiente. Esto no solo reduce los costos, sino que también permite escalar de manera más dinámica y manejar mayores volúmenes de tráfico.

Modelos pre-entrenados: Acelerando el desarrollo de aplicaciones de IA

EnergeticAI incluye una biblioteca de modelos pre-entrenados que abarcan una amplia gama de tareas de inteligencia artificial, como clasificación de imágenes, detección de objetos, procesamiento de lenguaje natural y más. Estos modelos están listos para usar, lo que ahorra tiempo y esfuerzo en el desarrollo y permite a los equipos centrarse en la implementación de la lógica de negocio.

Compatibilidad amplia: Manteniendo la familiaridad con TensorFlow.js

Aunque EnergeticAI está optimizado para funciones sin servidor, sigue siendo compatible con TensorFlow.js. Esto significa que los desarrolladores pueden aprovechar sus conocimientos y experiencia en TensorFlow.js sin necesidad de aprender una nueva API. La compatibilidad también facilita la migración de proyectos existentes a EnergeticAI.

| Característica | Descripción |

|---|---|

| Inicio rápido en frío | Reduce el tiempo de inicialización de funciones sin servidor. |

| Optimización de recursos | Minimiza el consumo de CPU y memoria. |

| Modelos pre-entrenados | Proporciona acceso a una biblioteca de modelos entrenados. |

| Compatibilidad amplia | Mantiene la compatibilidad con TensorFlow.js. |

| Integración sencilla | Ofrece APIs fáciles de usar para la integración con otras herramientas. |

¿Qué es TensorFlow y para qué sirve?

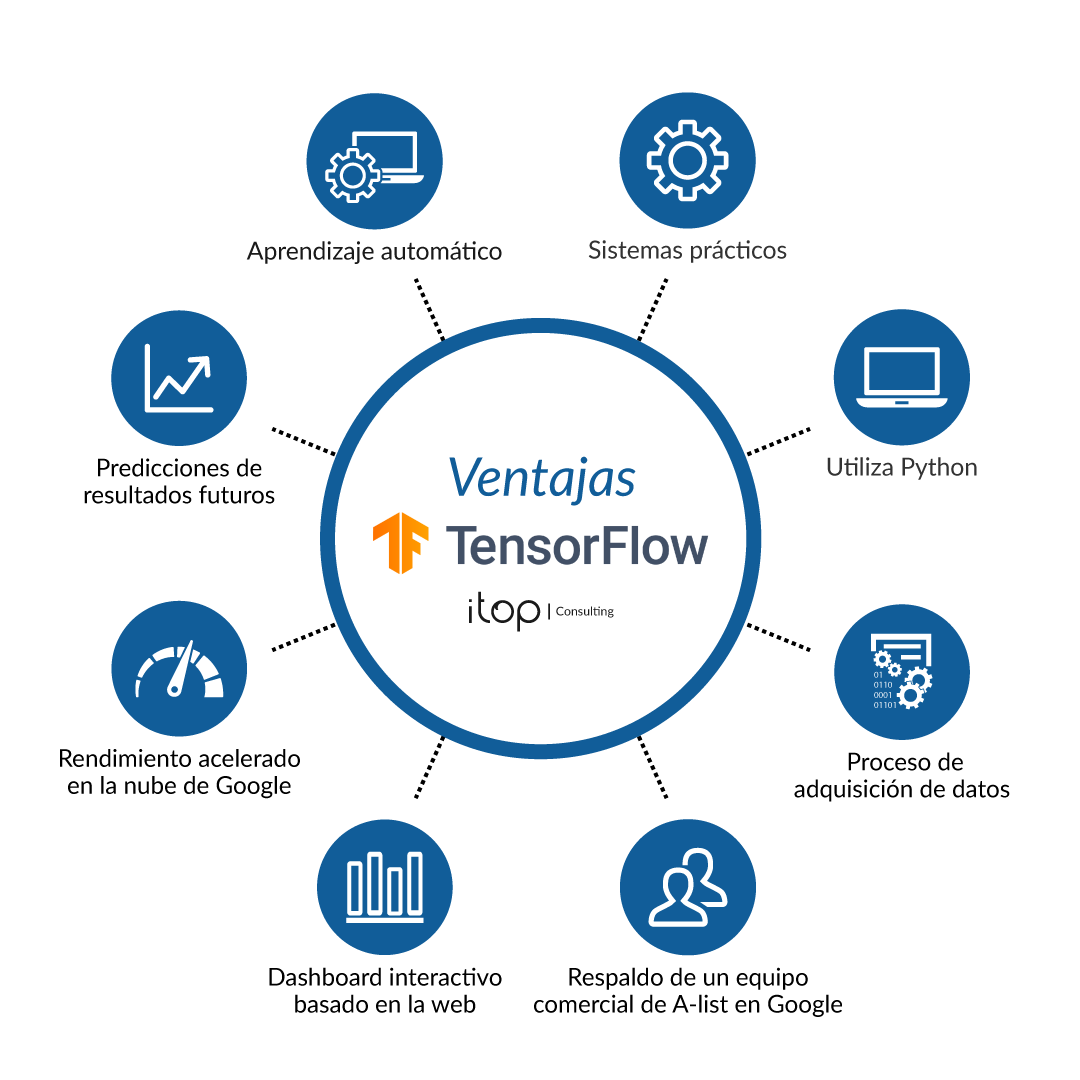

TensorFlow es una biblioteca de código abierto para el desarrollo y entrenamiento de modelos de aprendizaje automático (machine learning). Fue desarrollada por el equipo de investigación de Google Brain y lanzada en 2015. TensorFlow permite a los desarrolladores y científicos de datos crear, entrenar y desplegar modelos de aprendizaje profundo y machine learning de manera eficiente. Su flexibilidad y potencia la han convertido en una de las herramientas más populares en el ámbito del aprendizaje automático y la inteligencia artificial.

¿Qué es TensorFlow?

TensorFlow es una biblioteca de código abierto que facilita la creación y el entrenamiento de modelos de aprendizaje automático. Utiliza tensores (arrays multidimensionales) para realizar cálculos y representar datos, lo que permite una eficiencia y flexibilidad notable en el procesamiento de grandes volúmenes de información. TensorFlow es compatible con una amplia variedad de algoritmos y redes neuronales, lo que la hace versátil para aplicaciones que van desde el reconocimiento de imágenes hasta el procesamiento del lenguaje natural.

Características principales de TensorFlow

TensorFlow ofrece diversas características que la hacen una herramienta esencial en el desarrollo de modelos de aprendizaje automático:

- Fácil de usar: Con una sintaxis intuitiva y una gran comunidad de desarrolladores, TensorFlow es accesible para principiantes y expertos.

- Flexibilidad: Soporta una amplia gama de algoritmos y arquitecturas de red neuronal, lo que permite adaptarse a diferentes proyectos y requerimientos.

- Escalabilidad: Puede ejecutarse en una variedad de plataformas, desde computadoras personales hasta servidores y dispositivos móviles.

- TensorBoard: Une visualización y depuración con TensorBoard, una herramienta que permite monitorear y entender el comportamiento de los modelos.

- Compatibilidad: Se integra bien con otras bibliotecas y frameworks de aprendizaje automático, como Keras y PyTorch.

Aplicaciones de TensorFlow

TensorFlow se utiliza en una amplia variedad de aplicaciones y industrias:

- Reconocimiento de imágenes: Desarrollo de modelos que pueden identificar objetos, personas y acciones en imágenes y videos.

- Procesamiento del lenguaje natural (NLP): Creación de algoritmos que pueden analizar, comprender y generar texto humano.

- Sistemas de recomendación: Implementación de modelos que sugieren productos, contenido o acciones basados en el comportamiento del usuario.

- Análisis de datos: Uso de modelos de aprendizaje automático para extraer información valiosa de grandes conjuntos de datos.

- Medicina y ciencia>: Aplicación de modelos para mejorar el diagnóstico, la investigación y el tratamiento en la salud y la ciencia.

TensorFlow y el aprendizaje profundo

El aprendizaje profundo (deep learning) es un subcampo del aprendizaje automático que se centra en redes neuronales con múltiples capas, conocidas como redes neuronales profundas. TensorFlow es especialmente potente en el desarrollo y entrenamiento de estos modelos debido a su capacidad para manejar cálculos complejos y grandes volúmenes de datos.

- Optimización de gradientes: TensorFlow utiliza algoritmos como el descenso del gradiente para ajustar los parámetros del modelo de manera eficiente.

- Capas y funciones de activación: Proporciona una amplia gama de capas y funciones de activación que permiten diseñar redes neuronales complejas.

- Regularización: Ofrece métodos de regularización como el dropout y la normalización por lotes para evitar el sobreajuste.

- Transfer learning: Facilita el uso de modelos preentrenados para adaptarlos a nuevas tareas, ahorrando tiempo y recursos.

- Entrenamiento distribuido: Permite entrenar modelos en múltiples máquinas y GPUs, lo que acelera el proceso y permite trabajar con conjuntos de datos más grandes.

Comparación con otras bibliotecas de aprendizaje automático

Aunque existen otras bibliotecas y frameworks populares para el aprendizaje automático, TensorFlow se destaca por su flexibilidad y comunidad:

- Keras: TensorFlow incluye Keras como una API de alto nivel, lo que facilita la creación de modelos y la experimentación rápida.

- PyTorch: Mientras que PyTorch es conocido por su facilidad de uso y depuración dinámica, TensorFlow ofrece una mayor escalabilidad y compatibilidad con producción.

- Scikit-learn: Aunque Scikit-learn es excelente para modelos de aprendizaje automático tradicional, TensorFlow es más potente para aprendizaje profundo y redes neuronales.

- MXNet: MXNet es otra biblioteca de aprendizaje profundo que ofrece eficiencia y escalabilidad, pero TensorFlow tiene una comunidad y documentación más amplias.

- Caffe: Caffe es conocido por su eficiencia en procesamiento de imágenes, pero TensorFlow es más versátil y soporta una gama más amplia de aplicaciones.

¿Qué función de TensorFlow se usa para definir y entrenar modelos?

Para definir y entrenar modelos en TensorFlow, se utiliza principalmente la función tf.keras.Model. Esta función permite crear modelos de aprendizaje profundo de manera flexible y modular. A continuación, se detallan algunos aspectos importantes relacionados con la definición y entrenamiento de modelos en TensorFlow.

Creación de un Modelo en TensorFlow

Para crear un modelo en TensorFlow, se utiliza la clase tf.keras.Model. Esta clase permite definir la arquitectura del modelo de manera personalizada. Puedes definir capas y conectarnas en un grafo dirigido acíclico (DAG). Ejemplo:

- Definir las capas del modelo.

- Conectar las capas en el método

callpara definir el flujo de datos. - Inicializar el modelo con

tf.keras.Model().

Compilación del Modelo

Después de definir la arquitectura del modelo, es necesario compilar el modelo antes de entrenarlo. La función compile se usa para configurar el proceso de entrenamiento. Ejemplo:

- Especificar la función de pérdida con

loss. - Elegir el optimizador con

optimizer. - Definir métricas de evaluación con

metrics.

Entrenamiento del Modelo

El entrenamiento del modelo se realiza utilizando la función fit. Esta función permite entrenar el modelo en un conjunto de datos. Ejemplo:

- Especificar los datos de entrenamiento con

xyy. - Definir el número de épocas con

epochs. - Opcionalmente, especificar un conjunto de validación con

validation_data.

Evaluación del Modelo

Para evaluar el rendimiento del modelo, se utiliza la función evaluate. Esta función calcula las métricas de evaluación sobre un conjunto de datos de prueba. Ejemplo:

- Especificar los datos de prueba con

xyy. - Calcular las métricas de rendimiento del modelo.

- Devolver los resultados de las métricas.

Guardado y Carga de Modelos

Para guardar un modelo entrenado y cargarlo posteriormente, se utilizan las funciones save y load_model. Estas funciones permiten guardar el modelo en un archivo y cargarlo en sesiones de entrenamiento futuras. Ejemplo:

- Guardar el modelo con

model.save('path_to_model'). - Cargar el modelo con

tf.keras.models.load_model('path_to_model'). - Continuar el entrenamiento o realizar inferencias con el modelo cargado.

¿Qué hace realmente tensorflow?

TensorFlow es una plataforma de código abierto para el aprendizaje automático (Machine Learning, ML) desarrollada por Google. Permite a los desarrolladores y científicos de datos construir y entrenar modelos de aprendizaje automático de manera eficiente y a gran escala. TensorFlow proporciona una API versátil y flexible que soporta una amplia variedad de algoritmos y modelos, desde redes neuronales simples hasta modelos complejos y avanzados. Además, ofrece herramientas para desplegar y ejecutar modelos en una variedad de dispositivos, desde servidores de alto rendimiento hasta dispositivos móviles y de borde.

Funciones Básicas de TensorFlow

TensorFlow facilita la creación y entrenamiento de modelos de aprendizaje automático a través de una serie de funciones básicas:

- Data Ingestion: TensorFlow incluye herramientas para cargar y preprocesar datos, lo que es crucial para prepararlos para el entrenamiento de modelos.

- Model Building: Permite construir modelos utilizando una amplia variedad de capas y componentes predefinidos, facilitando la creación de arquitecturas complejas.

- Training: Incluye métodos optimizados para entrenar modelos de manera eficiente, utilizando técnicas como gradiente descendente y otras estrategias de optimización.

- Evaluation: Proporciona herramientas para evaluar el rendimiento de los modelos, incluyendo métricas de precisión, pérdida y otras métricas de rendimiento.

- Inference: Permite hacer predicciones con modelos entrenados, tanto en entornos de producción como en dispositivos móviles y de borde.

Compatibilidad con Hardware

TensorFlow es altamente compatible con una variedad de hardware, lo que lo hace versátil para diferentes aplicaciones:

- CPUs: Funciona eficientemente en procesadores estándar, lo que lo hace accesible para desarrollo y pruebas en entornos de escritorio.

- GPUs: Aprovecha la potencia de las tarjetas gráficas para acelerar los cálculos, especialmente útiles para el entrenamiento de modelos grandes y complejos.

- TPUs: Ofrece soporte nativo para las TPUs (Tensor Processing Units) de Google, aceleradores de hardware diseñados específicamente para el aprendizaje automático.

- Móviles: Permite desplegar modelos en dispositivos móviles y de borde, facilitando la implementación de aplicaciones en tiempo real.

- Inferencia en el Borde: Optimiza el rendimiento y la eficiencia energética para la inferencia en dispositivos de borde, lo que es crucial para aplicaciones IoT y de procesamiento en el borde.

APIs y Bibliotecas

TensorFlow ofrece una amplia variedad de APIs y bibliotecas que facilitan el desarrollo y la implementación de modelos:

- TensorFlow Core: La API de bajo nivel que ofrece un control detallado sobre el proceso de construcción y entrenamiento de modelos.

- TensorFlow Lite: Una versión ligera de TensorFlow para dispositivos móviles y de borde, optimizada para un rendimiento eficiente en dispositivos con recursos limitados.

- TensorFlow.js: Permite construir y ejecutar modelos de aprendizaje automático en el navegador web, lo que abre nuevas posibilidades para aplicaciones web interactivas.

- TensorFlow Extended (TFX):strong> Un framework para la implementación de pipelines de aprendizaje automático en producción, diseñado para escalar y automatizar flujos de trabajo.

- Keras: Una API de alto nivel que facilita la creación y entrenamiento de modelos, popular por su simplicidad y facilidad de uso.

Aplicaciones de TensorFlow

TensorFlow es utilizado en una amplia gama de aplicaciones de aprendizaje automático:

- Vision por Computadora: Se utiliza para tareas como la detección de objetos, reconocimiento de imágenes y segmentación semántica.

- Análisis de Texto: Facilita el desarrollo de modelos para tareas de procesamiento de lenguaje natural, como clasificación de texto, traducción y generación de texto.

- Recomendaciones: Se utiliza para construir sistemas de recomendación personalizados, mejorando la experiencia del usuario en plataformas de comercio electrónico y entretenimiento.

- Control de Robots: Permite programar y entrenar robots para realizar tareas complejas, desde la manipulación de objetos hasta la navegación autónoma.

- Diagnóstico Médico: Se utiliza en el sector de la salud para ayudar en la detección de enfermedades y el análisis de imágenes médicas.

Comunidad y Ecossistema

TensorFlow cuenta con una amplia comunidad y un ecosistema robusto que lo hace un Choice popular: Para utilizar TensorFlow, necesitas cumplir con una serie de requisitos y configurar tu entorno de desarrollo adecuadamente. A continuación, te detallo los principales elementos que debes considerar: 1. Sistema Operativo: TensorFlow es compatible con Windows, macOS y Linux. Asegúrate de que tu sistema operativo esté actualizado para evitar problemas de compatibilidad. 2. Versión de Python: TensorFlow requiere Python 3.7 o superior. Es importante instalar la versión adecuada de Python y configurar tu entorno de desarrollo para que use esta versión. 3. Entorno Virtual: Se recomienda crear un entorno virtual para aislar las dependencias de TensorFlow. Puedes usar herramientas como virtualenv o conda para gestionar tus entornos. 4. Instalación de TensorFlow: Puedes instalar TensorFlow a través de Pip o Conda. La instalación más común es mediante Pip, ejecutando el comando: pip install tensorflow Si necesitas una versión específica, puedes especificarla: pip install tensorflow==2.x.x 5. Dependencias Adicionales: Asegúrate de tener instaladas las dependencias necesarias, como NumPy y Matplotlib, que son útiles para el manejo de datos y la visualización de resultados. 6. GPU (Opcional): Si deseas acelerar los cálculos con una GPU, necesitarás instalar TensorFlow GPU. Esto implica instalar también NVIDIA CUDA Toolkit y cuDNN. La Documentación Oficial de TensorFlow proporciona los pasos detallados para esta instalación. 7. IDE o Editor de Código: Puedes usar cualquier IDE o editor de código que soporte Python, como PyCharm, Visual Studio Code o Jupyter Notebook, para escribir y ejecutar tus scripts de TensorFlow. TensorFlow es una plataforma de aprendizaje automático desarrollada por Google. Esta biblioteca permite a los desarrolladores y científicos de datos construir y entrenar modelos de aprendizaje profundo y machine learning. Se utiliza en una amplia variedad de aplicaciones, desde la clasificación de imágenes hasta la traducción de idiomas y la recomendación de productos. Sus características incluyen: La instalación de TensorFlow en un entorno virtual es una práctica recomendada para evitar conflictos con otras dependencias. Puedes seguir estos pasos: Las dependencias principales de TensorFlow son esenciales para que la biblioteca funcione correctamente. Las más importantes incluyen: Una vez que hayas instalado TensorFlow, es importante verificar que todo esté funcionando correctamente. Puedes hacerlo ejecutando un script sencillo: TensorFlow se utiliza en una amplia variedad de aplicaciones en la vida real. Algunos de los usos más comunes incluyen: EnergeticAI es una versión optimizada de TensorFlow.js que se ha diseñado específicamente para funciones sin servidor, también conocidas como serverless. Su principal objetivo es proporcionar un inicio rápido en frío (cold start) y ofrecer modelos pre-entrenados para facilitar la implementación de soluciones de inteligencia artificial en entornos de computación en la nube. Esta optimización es crucial para mejorar la eficiencia y la velocidad de respuesta en aplicaciones que requieren un despliegue rápido y eficiente. EnergeticAI se destaca por su capacidad para minimizar el tiempo de inicio en frío (cold start), que es un desafío común en entornos sin servidor. En el contexto de las funciones sin servidor, el inicio en frío ocurre cuando una función no ha sido ejecutada recientemente y necesita ser inicializada desde cero. EnergeticAI logra esta optimización mediante la pre-carga de recursos y la reducción de la latencia asociada con la carga de modelos y la inicialización del entorno de ejecución. Esto resulta en un tiempo de respuesta más rápido y una mejor experiencia para los usuarios finales. Los modelos pre-entrenados de EnergeticAI proporcionan varias ventajas significativas. En primer lugar, facilitan la implementación rápida de soluciones de inteligencia artificial, ya que los desarrolladores no necesitan entrenar modelos desde cero. Esto reduce el tiempo y los recursos necesarios para poner en marcha un proyecto. Además, estos modelos pre-entrenados suelen estar basados en conjuntos de datos extensos y de alta calidad, lo que garantiza una precisión y una reliabilidad superiores en comparación con modelos entrenados con datos más limitados. Finalmente, los modelos pre-entrenados pueden ser ajustados o fine-tuned para adaptarse a casos de uso específicos, lo que ofrece flexibilidad y personalización sin sacrificar la eficiencia. EnergeticAI es especialmente útil en una amplia gama de aplicaciones que requieren el procesamiento rápido y eficiente de datos en tiempo real. Algunos ejemplos incluyen análisis de imágenes y video, reconocimiento de voz, clasificación de texto y detección de anomalías. En el ámbito del Internet de las Cosas (IoT), EnergeticAI puede procesar datos de sensores de manera eficiente y tomar decisiones rápidas basadas en modelos de inteligencia artificial. Asimismo, es ideal para aplicaciones web y móviles que necesitan integrar funcionalidades de IA sin sacrificar el rendimiento ni la rapidez de respuesta. En resumen, EnergeticAI es una solución versátil que puede adaptarse a una variedad de necesidades y contextos tecnológicos.¿Qué necesito para usar TensorFlow?

1. ¿Qué es TensorFlow y para qué se usa?

2. ¿Cómo instalar TensorFlow en un entorno virtual?

python -m venv myenv

source myenv/bin/activate En Linux y macOS

myenvScriptsactivate En Windows

pip install tensorflow

3. ¿Qué son las dependencias principales de TensorFlow?

4. ¿Cómo verificar la instalación de TensorFlow?

import tensorflow as tf

print(tf.__version__)

5. ¿Cuáles son los principales usos de TensorFlow en la vida real?

Preguntas Frecuentes de Nuestra Comunidad (FAQ)

¿Qué es EnergeticAI y cuál es su propósito?

¿Cómo mejora EnergeticAI el inicio en frío de las funciones sin servidor?

¿Qué ventajas ofrecen los modelos pre-entrenados de EnergeticAI?

¿En qué tipo de aplicaciones se puede utilizar EnergeticAI?

Deja una respuesta

Nuestros Artículos Recomendados